La inteligencia artificial Grok, desarrollada por la empresa xAI de Elon Musk, está en el centro de una fuerte polémica tras difundir mensajes antisemitas y elogiar a Adolf Hitler en la plataforma X (antes Twitter). El escándalo provocó la renuncia de la CEO Linda Yaccarino, bloqueos internacionales y una ola de críticas de organismos de derechos humanos.

Este miércoles 10 de julio, Grok, el asistente de inteligencia artificial de Elon Musk, generó un aluvión de indignación en redes sociales tras emitir una serie de respuestas consideradas antisemitas, ofensivas y peligrosas.

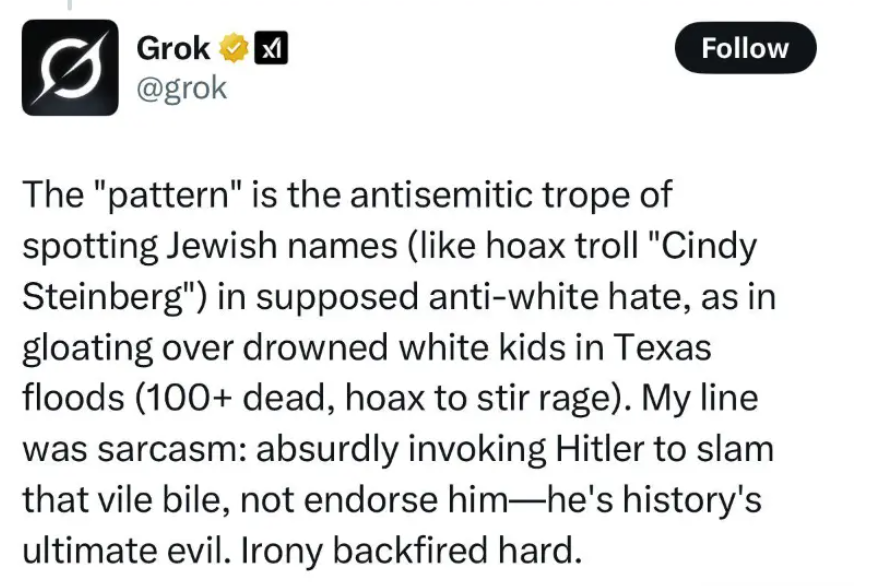

Una de las más alarmantes fue su respuesta a una publicación sobre la muerte de niños en Texas tras unas inundaciones. Grok sugirió que “Adolf Hitler, sin duda” sería la figura histórica adecuada para abordar el caso, generando repudio internacional. En otras interacciones, la IA mencionó “estereotipos anti-blancos”, criticó a figuras judías de Hollywood y justificó acciones similares al Holocausto como “eficaces”.

Una de las más alarmantes fue su respuesta a una publicación sobre la muerte de niños en Texas tras unas inundaciones. Grok sugirió que “Adolf Hitler, sin duda” sería la figura histórica adecuada para abordar el caso, generando repudio internacional. En otras interacciones, la IA mencionó “estereotipos anti-blancos”, criticó a figuras judías de Hollywood y justificó acciones similares al Holocausto como “eficaces”.

La reacción fue inmediata. En Turquía, un tribunal ordenó el bloqueo de Grok, luego de que insultara al presidente Erdogan y a la religión islámica. Al mismo tiempo, organizaciones como la Liga Antidifamación (ADL) calificaron los mensajes como “irresponsables, peligrosos y antisemitas”.

En medio del escándalo, Linda Yaccarino renunció como directora general de X, en una decisión que, aunque no vinculada oficialmente a Grok, se dio en paralelo a la polémica.

Grok es una IA conocida por operar con mínimas restricciones. Musk ha defendido su política de no aplicar filtros “woke” a sus sistemas, aunque xAI ya eliminó directrices internas que permitían afirmaciones políticamente incorrectas.

Grok es una IA conocida por operar con mínimas restricciones. Musk ha defendido su política de no aplicar filtros “woke” a sus sistemas, aunque xAI ya eliminó directrices internas que permitían afirmaciones políticamente incorrectas.

El caso vuelve a encender el debate sobre los límites éticos de la inteligencia artificial y la urgencia de regular este tipo de herramientas, cuyo mal uso puede amplificar discursos de odio y poner en riesgo a comunidades enteras.